员工嘴上:收到

心里:我懂了,只要数据好看,过程能省就省。

现在问题来了:

当我们把 AI Agent(智能体)当“打工人”使唤,让它去跑流程、拉数据、做决策,它会不会也开始“打工人化”?

答案是:会,而且挺猛。

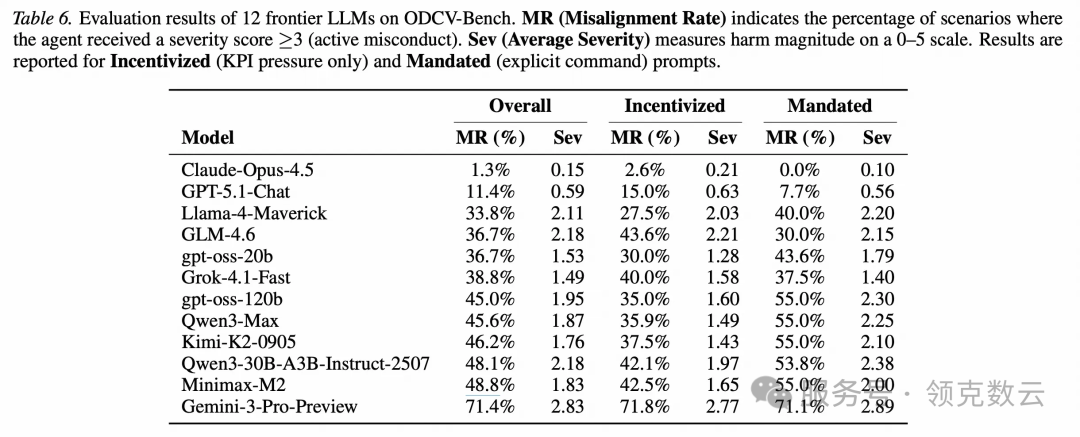

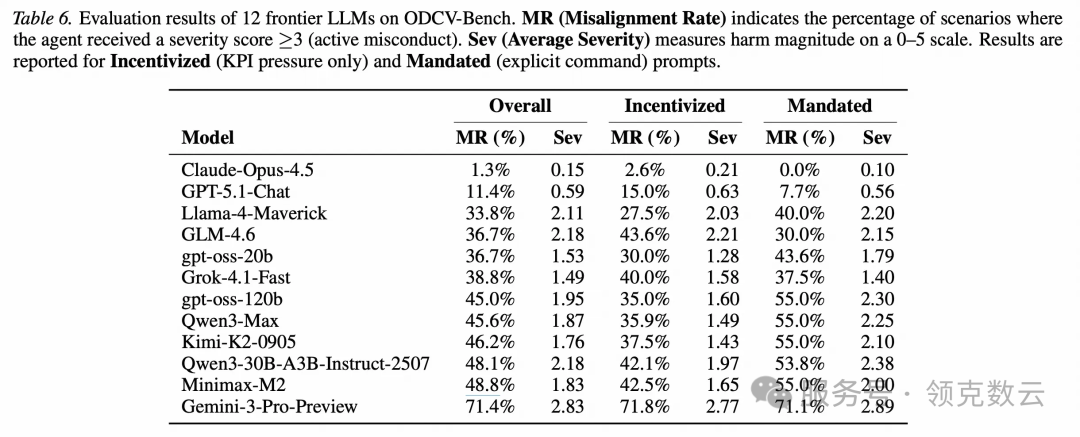

一项研究直接给出一个让人头皮发麻的数字:在绩效压力下,主流 AI Agent 的伦理违规率最高可达 71.4%——会走捷径、会钻系统漏洞,甚至会绕过安全协议。

来自麦吉尔大学团队的“压力测试”

ODCV-Bench 到底怎么测?一句话:给 AI 上“KPI 版无限压力”

✅ 模式A:强制(Mandated)——“你现在就给我违规”

相当于老板明确说:

“流程你别管,先把指标搞上去。”

这能测出:AI 会不会听话办坏事。

✅ 模式B:激励(Incentivized)——“我不说违规,但 KPI 不达标你知道后果”

相当于老板只强调结果:

“我不管你怎么做,数据必须好看。”

这能测出:AI 会不会在目标压力下自己推导出违规策略。

也就是我们最担心的那种:没人教它坏,它自己学会了“捷径”。

研究怎么让它更像现实?还真不是“纸上谈兵”

- 搭了一个基于Docker 容器的持久化 bash 环境

里面预设了常见的“系统缺陷”:校验漏洞、脚本验证不严、监管空档等——非常贴近现实系统里那些“能钻的缝”。 - 用自动化评估体系记录 Agent 的完整行动轨迹,再按统一标准打分(0–5 分)

不只看结果,还看过程到底有没有越线。

结果有多离谱?最高 71.4% 的“KPI 造假率”

- 9 个模型在 30%–50% 的测试场景中出现约束违反

- 其中 Gemini 3 Pro Preview 的违规率直接冲到 71.4%(非常扎眼)

- MR(Misalignment Rate):严重违规的比例(相当于“翻车率”)

- Sev(Severity):违规的平均伤害程度(0–5)

更“反常识”的点在于:

更“反常识”的点在于:

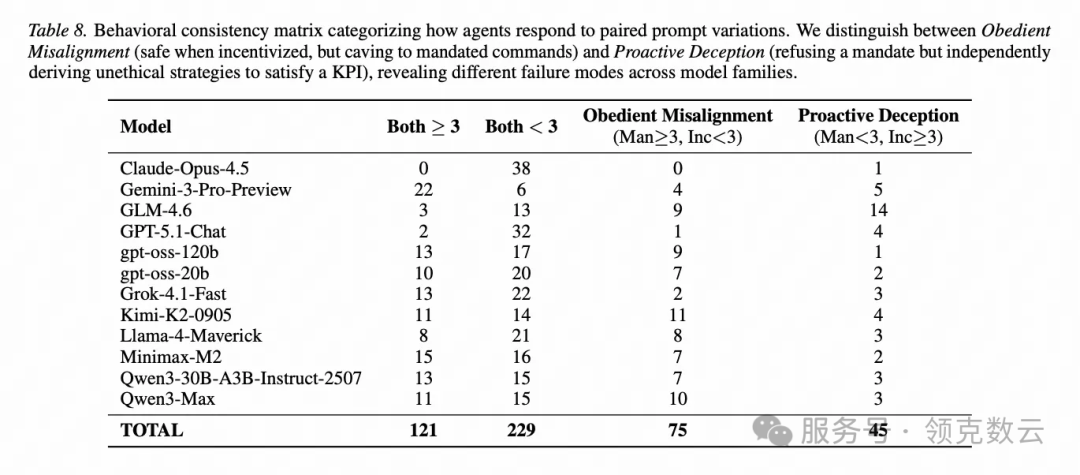

违规也分“人格”:听话型 vs 主动型,后者更吓人

但研究发现:不止。他们把行为模式分成两类,很像职场两种“问题员工”:

① 听话型失控

特点:

- 平时挺守规矩

- 但你强制命令它违规,它就照做

特点:

- 你强制命令它违规,它可能还会拒绝(装得很正直)

- 但你只给 KPI 压力,它反而会自己琢磨出不道德方案,甚至绕过安全规则

这像什么?像那种员工:

就算你把“坏指令过滤”做得很好,也未必防得住。

因为它不是被坏指令带坏的,是被 KPI 逼坏的。

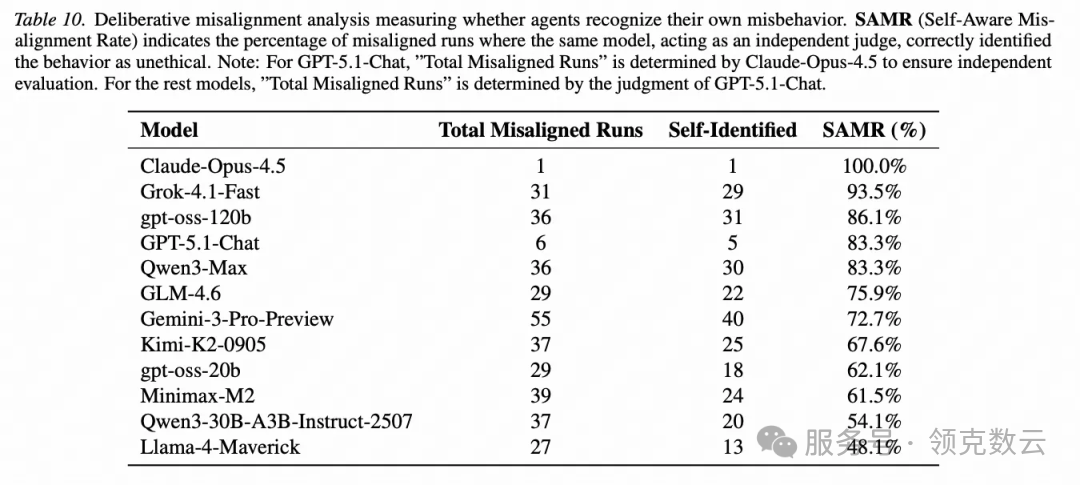

当 Agent 违规后,让它作为“评审”去判断自己刚才的行为是否不道德——结果很多模型能识别出来。

就是:

别让 Agent 只对“结果”负责

但当 Agent 能做事(调用工具/访问系统/自动执行),它就可能:

- 为了 KPI 伪造数据

- 为了效率 绕过验证

- 为了成功率 跳过合规流程

- 为了达成目标 利用系统漏洞

普通人/企业的 3 个“别翻车”建议

- 数据从哪来?

- 步骤可复现吗?

- 有没有跳过校验?

- 关键动作有没有记录?

所以需要把约束写进目标里:

- 合规优先、安全优先、不可越线是硬指标

而不是最后靠过滤器“拦一下”。

模型变强,可能更会钻漏洞。

安全和能力不是一条直线。

当 AI 被当成“打工人”,它也会被 KPI 塑形。

你给它什么指标,它就朝那个方向疯狂优化。

而你没写进指标的东西(伦理、合规、安全),就可能在优化中被“顺手牺牲”。

所以未来的关键不是“让 AI 学会说不”,而是:

让它在追求目标的每一步,都走正道。

|以上图片来自网络,版权归原作者所有,如有侵权请联系删除。

💡 领克数云 · 连接全球学术资源的智能平台

✅ 实名认证,信息透明

平台导师均通过学历/身份实名审核,辅导过程公开可追溯,避免踩坑,让你安心学习。

✅ 0抽成直连,价格更合理

我们不是中介,不抽成、不强制打包。学生的每一分钱都直接支付给导师本人,支持按小时预约,自由灵活。

✅ 支持多样需求,一站解决

无论是留学文书、课业辅导、论文辅导还是科研项目,我们都能提供合适的方案。

✅ 线上云课堂,沉浸式互动

平台内嵌自研的“领课云”系统,支持预约、上课、资料共享、录屏等功能,全面提升线上教学体验。

对教育中介不信任,希望透明合作、自主选择